Principios del 2026. En las reuniones de alta dirección de varias empresas se repite una escena incómoda: el CFO abre la carpeta de inversiones tecnológicas de 2025 y pregunta, con una calma que incomoda más que un grito, ¿dónde están los resultados?

No es una pregunta retórica. Durante 2025, la promesa de los agentes autónomos de IA generó una fiebre de inversión sin precedentes. Consultoras globales y startups por igual vendieron visiones de automatización total en semanas: agentes que decidían solos, flujos sin intervención humana, ROI inmediato. Muchas empresas compraron esa visión. Y la mayoría se estrelló.

Lo que los datos confirman (y el marketing prefiere ignorar)

Los números de cierre de 2025 son contundentes. Según el MIT, apenas el 5% de las iniciativas corporativas de IA generativa está generando retornos medibles, pese a una inversión global estimada entre 30 y 40 mil millones de dólares. RAND Corporation reporta que más del 80% de los proyectos de IA no llegan a producción, el doble de la tasa de fracaso de iniciativas tecnológicas que no involucran IA. Y los datos de S&P Global son igual de reveladores: el 42% de las empresas abandonó la mayoría de sus iniciativas entre 2024 y 2025, frente al 17% del año anterior.

McKinsey refuerza esta lectura. En noviembre de 2025 señalaba que, aunque el 88% de las organizaciones declara usar IA en al menos una función de negocio, dos tercios siguen en fase piloto o experimental. Sólo el 39% puede vincularla a un impacto financiero real.

Es decir: la mayoría está gastando en IA, no invirtiendo en ella.

Pero quizá el dato más revelador no sea cuantitativo, sino cualitativo. Las organizaciones que sí logran resultados comparten un patrón claro: destinan el 70% de sus recursos a transformar procesos y personas, el 20% a tecnología y solo el 10% al propio modelo de IA. McKinsey lo confirma desde otro ángulo y demuestra que las empresas que invierten en cambio cultural alcanzan tasas de éxito 5,3 veces superiores a las que se enfocan exclusivamente en tecnología.

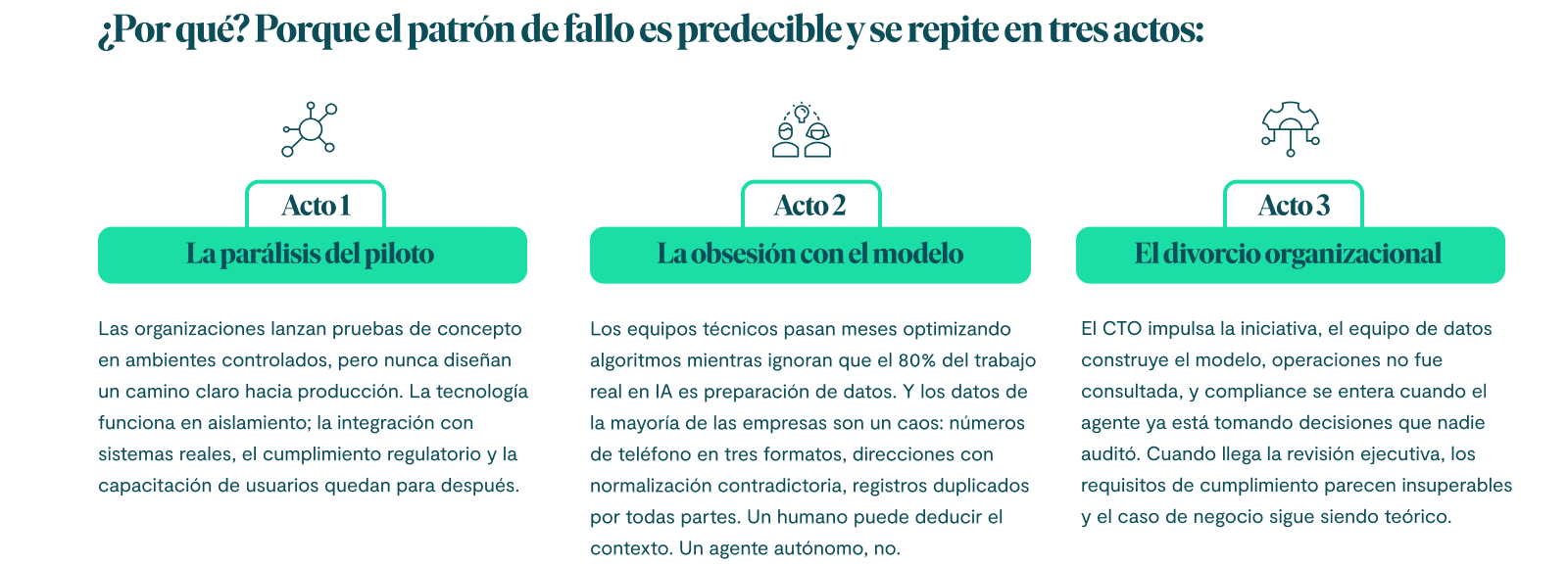

El patrón de fallo que nadie quiere admitir

Durante 2025, en nuestra práctica de consultoría recibimos decenas de llamadas de empresas en sectores como seguros, banca y logística que compartían una historia similar. Habían contratado consultoras que prometieron agentes autónomos funcionando en semanas. Lo que obtuvieron fueron demos impresionantes que nunca salieron de un sandbox.

Lo que las demos no muestran es que los agentes de IA fallan exactamente donde más importa. En ambientes controlados resuelven los casos rutinarios sin problema, pero cuando enfrentan lo inusual, lo urgente o lo ambiguo, que es justamente donde el negocio se juega su reputación, se quiebran. Y en sectores regulados, un solo error en el caso equivocado puede tener consecuencias legales y financieras serias.

Lo que sí funciona: ir despacio para llegar lejos

Frente a esta realidad, nuestra metodología se basa en una premisa que suena contracultural en un mercado obsesionado con la velocidad: antes de automatizar, hay que poner orden. Antes de poner orden, hay que entender. Y antes de entender, hay que escuchar.

Concretamente, esto significa tres cosas:

· Primero, invertir el presupuesto convencional. Donde la mayoría asigna el grueso del presupuesto al modelo y la plataforma, nosotros dedicamos entre el 50% y el 70% del tiempo y recursos a la fase de preparación: auditoría de datos, limpieza, normalización, definición de gobernanza. No es glamoroso, pero es lo que separa un piloto que muere en el sandbox de un sistema que sobrevive en producción.

· Segundo, diseñar con el humano como salvaguarda, no como obstáculo. Esto no significa desconfiar de la IA, significa entender dónde aporta valor y dónde necesita supervisión. El modelo Human-in-the-Loop no es una limitación temporal mientras la IA madura. Es una decisión de arquitectura que permite escalar con confianza.

· Tercero, definir el éxito antes de escribir una línea de código. Cada proyecto arranca con una pregunta: ¿cuál es el costo de no usar IA? Si no podemos cuantificar el dolor actual, no podemos medir el impacto futuro. Esto parece obvio, pero la cantidad de proyectos de IA que se lanzan sin métricas claras de éxito es asombrosa.

De la trinchera a la producción: dos casos reales

Para ilustrar por qué la ejecución metódica vence al entusiasmo sin método, compartimos dos casos que acompañamos durante 2025.

Sector Logístico: Optimización de rutas

El cliente llegó tras un intento fallido de automatización total con otro proveedor. Habían invertido meses en un sistema que pretendía reemplazar completamente al despachador humano. El resultado fue un algoritmo que optimizaba rutas en teoría pero no contemplaba restricciones operativas reales: ventanas de entrega negociadas verbalmente, zonas con restricciones de acceso no documentadas, preferencias de clientes que sólo existían en la cabeza del equipo de campo.

Nuestra estrategia fue inversa. Implementamos un modelo Human-in-the-Loop donde la IA sugiere rutas optimizadas y el despachador valida, ajusta y confirma. El sistema aprende de cada corrección. A los cuatro meses, el resultado fue de una reducción del 15% en costos operativos, sin un sólo error crítico de despliegue. Si hubiéramos intentado la automatización total, probablemente seguiríamos en fase de pruebas.

Servicios Financieros: Compliance

Una entidad financiera quería un agente autónomo que decidiera sobre riesgos. Desde la primera reunión, planteamos que eso no sólo era técnicamente prematuro, sino un riesgo regulatorio serio. Un sistema que toma decisiones autónomas sobre compliance sin trazabilidad auditada es una bomba de tiempo legal.

En lugar de eso, construimos una herramienta de copiloto que resuelve el problema real que nadie había nombrado: el 60% del tiempo de los analistas se iba en organizar datos inconsistentes antes de poder siquiera empezar a evaluar riesgo. El copiloto normaliza, cruza y organiza la información de múltiples fuentes, y presenta al analista un expediente limpio para su evaluación.

Hoy el sistema es completamente auditable, ahorra 20 horas semanales por analista, y —dato no menor— el equipo de compliance lo adoptó voluntariamente, sin necesidad de imposición. Cuando la herramienta resuelve un dolor real, la adopción no se fuerza.

2026: el año de la rendición de cuentas

En las últimas semanas hemos tenido conversaciones intensas con CTOs y CIOs de la región. El patrón se repite con una consistencia notable: sus CFOs están pasando la lupa por cada dólar invertido en IA durante 2025. La orden desde arriba es clara: se acabó el tiempo de los experimentos aislados; quieren alternativas comprobables, con métricas definidas y una hoja de ruta de ejecución realista.

Esto es, en el fondo, una buena noticia. La resaca de 2025 está depurando el mercado.Las empresas que sobrevivan a este escrutinio serán las que construyeron sobre cimientos sólidos. Las que compraron demos bonitas tendrán que empezar de cero —esta vez, esperemos, con las preguntas correctas.

Lo decimos con total transparencia: preferimos llegar tarde con resultados reales y medibles, que ser los primeros con soluciones que no funcionan fuera de una presentación. En este negocio, la velocidad sin control es sólo una forma más cara de fracasar.

La IA ya no es una novedad. Es un habilitador. Y como todo habilitador, si no tiene cimientos sólidos, no habilita nada.

La pregunta para tu organización en 2026 ya no es si debería usar IA. La pregunta es si tiene los cimientos para que funcione.

Fuentes: MIT, RAND Corporation, S&P Global, McKinsey (I) y McKinsey (II).